Technologie, Digitalisierung und Menschenrechte

Wie können wir unsere Menschenrechte in der digitalen Welt schützen?

Wir stehen vor neuen menschenrechtlichen Herausforderungen. Es ist höchste Zeit, dass Technologie den Menschen und die Menschenrechte in den Mittelpunkt stellt. Um Menschenrechte zu schützen, müssen wir die Zukunft der Technologien gestalten. Amnesty International arbeitet mit Untersuchungen, Recherchen und Kampagnen daran, Technologie zu Gunsten von Menschen und ihren Rechten zu verändern. Es ist an der Zeit,

- das Internet umzugestalten, so dass Menschen und Menschenrechte Priorität haben. Wir müssen sicherstellen, dass Big Tech Unternehmen wirksam reguliert werden, damit Menschenrechte geschützt werden und die Transparenz und Rechenschaftspflicht von Unternehmen verstärkt wird.

- Widerstand zu leisten, wenn Technologien mit dem Ziel genutzt werden, Aktivist*innen mundtot zu machen. Wir müssen rechtswidrige Überwachung, Zensur und Internetabschaltung verhindern.

- die Codes so umzuschreiben, dass Menschenrechte geschützt werden. Diskriminierung und Vorurteile dürfen nicht mehr in Algorithmen einprogrammiert werden, die lebensverändernde Entscheidungen über uns treffen.

Unsere Untersuchungen haben deutlich gezeigt, dass die Algorithmen von Facebook, die darauf ausgerichtet sind, Engagement und Unternehmensgewinne um jeden Preis zu fördern, den Hass geschürt und zu Massengewalt sowie zur Zwangsvertreibung der Rohingya-Bevölkerung Myanmars beigetragen haben. Meta muss Wiedergutmachung leisten und sein Geschäftsmodell ändern, um zu verhindern, dass sich so etwas wiederholt.

Pat de Brún, Leiter der Abteilung Big Tech Accountability bei Amnesty International

Gemeinsam gegen das Geschäftsmodell der Überwachung

Jede unserer Bewegungen – was wir lesen, wen wir kennen, wohin wir gehen, sogar was wir denken – wird ständig von einer Handvoll mächtiger Unternehmen, darunter Meta und Google, verfolgt.

Je mehr Zeit wir damit verbringen, auf ihren Plattformen zu scrollen, desto mehr Daten sammeln sie und desto mehr Geld können sie verdienen. Das Geschäftsmodell der Überwachung bewirkt eine Zunahme von hetzerischen und hasserfüllten Inhalten – mit zerstörerischen Konsequenzen im realen Leben, wie etwa die Rolle von Facebook bei der ethnischen Säuberung der verfolgten Minderheit der Rohingya in Myanmar zeigt.

Gefährlich ist das Geschäftsmodell auch, weil zum stundenlangen Weiterscrollen animiert und gezielt süchtig gemacht wird. Das zeigte Amnesty International auch durch Recherchen über die Social-Media-Plattform TikTok auf, wo schädliche Inhalte depressive Gedanken und Selbstverletzung bei Kindern und Jugendlichen romantisieren und fördern können.

Amnesty International setzt sich dafür ein, große Technologie- und Social-Media-Unternehmen wie Alphabet (Google), Meta (Facebook), TikTok und X (ehemals Twitter) zur Rechenschaft zu ziehen. Wir zeigen die Schäden auf, die das Geschäftsmodell der Überwachung von Big Tech-Unternehmen verursacht. Wir fordern mehr Transparenz und Rechenschaftspflicht für Big Tech-Unternehmen.

Und wir kämpfen mit unseren Kampagnen dafür, dass diese Unternehmen effektiv reguliert werden, um Menschenrechte zu schützen.

Zivilgesellschaft gegen Cyberangriffe verteidigen

Von Mexiko bis Marokko nutzen Regierungen eine Vielzahl ausgefeilter Cyber-Tools, um Aktivist*innen und Journalist*innen unrechtmäßig auszuspionieren. Wenn Regierungen diejenigen angreifen, die unsere Rechte verteidigen, sind wir alle in Gefahr.

Das Security Lab von Amnesty International führt bahnbrechende technische Untersuchungen zu Cyberangriffen gegen Aktivist*innen und Journalist*innen durch. Es entwickelt Werkzeuge und Dienstleistungen, um sie vor Angriffen zu schützen und unterstützt Aktivist*innen dabei, digitale Gefahren zu erkennen und darauf zu reagieren.

Das Digital Forensics Fellowship von Amnesty International fördert das technische Verständnis von Aktivist*innen weltweit durch Zusammenarbeit mit Expert*innen des Security Labs, um digitale Bedrohungen abzuwehren und die Zivilgesellschaft zu schützen.

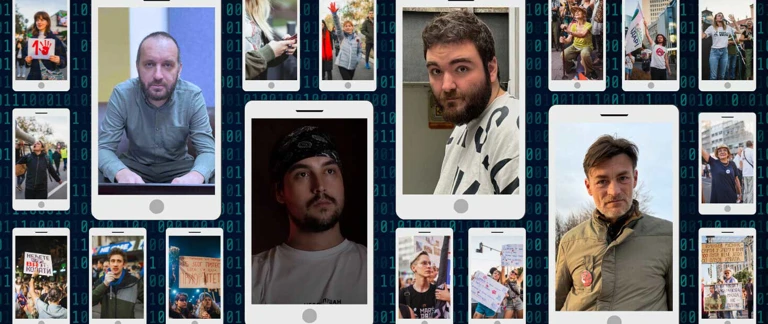

Verbot von Gesichtserkennungstechnologie

Biometrische Technologien – von Gesichtserkennung über Körpersprache- bis hin zur Emotionserkennung – bedrohen unsere Menschenrechte. Sie verstärken systemische Diskriminierung und werden oft von Strafverfolgungsbehörden gegen marginalisierte Gruppen eingesetzt. Wir untersuchen die Auswirkungen solcher Technologien und setzen uns für ein Verbot von digitalen Infrastrukturen ein, die nicht mit den Menschenrechten vereinbar sind. Wir fordern ein Verbot von Gesichtserkennungstechnologien, die die Privatsphäre verletzen und die Meinungsäußerungsfreiheit, sowie das Recht auf friedliche Versammlung gefährden. Auch in Österreich ist es aus menschenrechtlicher Sicht besorgniserregend, dass Gesichtserkennungstechnologie ohne klare gesetzliche Grundlage zum Einsatz kommt – und damit verbundene Eingriffe in unsere Menschenrechte somit unrechtmäßig erfolgen.

Verantwortung für gefährliche Algorithmen einfordern

Immer öfter übernehmen Maschinen die Entscheidung, wer Anspruch auf Wohnraum, Bildung, Gesundheitsfürsorge und Unterstützungsleistungen hat. Das ist gefährlich: Ohne angemessene Schutzmaßnahmen können die auf Algorithmen basierenden Systeme die Diskriminierung in unserer Gesellschaft verstärken, verfestigen und automatisieren. Das Algorithmic Accountability Lab von Amnesty International ist ein globales Team aus Data Scientists, Researcher*innen zu Menschenrechten und Expert*innen für wirtschaftliche und soziale Rechte. Gemeinsam untersuchen sie solche von Staaten eingesetzte Algorithmen.